Filosofia

Cos’è l’Algoretica (e perchè riguarda il nostro futuro)

In ambito di riflessione in merito alle nuove dinamiche derivanti dall’interazione tra agenti AI ed agenti biologici è molto in voga il termine ‘algoretica’. Di cosa si tratta? Cosa si intende quando si adopera tale locuzione? Scopo della presente brevissima comunicazione è, per l’appunto, tirare un po’ le fila del discorso in merito al fine di introdurre nell’agone pubblico l’orizzonte semantico di questa nuova espressione.

Il termine algoretica nasce dalla fusione di ‘algoritmo’ ed ‘etica’, ed indica, conseguenzialmente, quell’ambito di riflessione, tanto filosofica quanto interdisciplinare, che si occupa delle implicazioni morali, giuridiche e sociali dei processi decisionali automatizzati.

Il termine lo si deve a Paolo Benanti nel volume Oracoli. Tra algoretica e algocrazia, risalente al 2018. In esso, si propone di offrire una risposta all’urgenza di governare i nuovi poteri cognitivi degli algoritmi in un modo che possa sensatamente qualificarsi come responsabile ed umano[1].

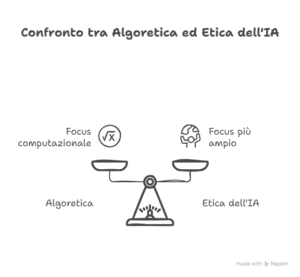

A differenza della più ampia AI Ethics, comunque, l’algoretica si concentra sulla natura decisamente più computazionale dell’agire algoritmico, e segnatamente sui criteri morali che dovrebbero presiederlo in sede stessa di progettazione. Senza alcuna pretesa di esaustività, i seguenti sono i principali criteri morali richiesti in sede di design degli algoritmi:

- trasparenza;

- equità;

- non maleficenza;

- responsabilità;

- controllo umano[2].

Alcuni di questi sono decisamente interdisciplinari, come ad esempio b), c) e d), dal momento che riguardano pure la riflessione bioeticistica.

- Cornice storica

L’interesse per le implicazioni etiche delle tecnologie digitali si sviluppa già durante gli anni Novanta all’interno della Computer Ethics, ma è solo nel secondo decennio del XXI secolo che, sotto l’urgenza regolatoria e a causa della pervasività dell’IA, prende avvio una nuova stagione teorica. A tal proposito, un ruolo importante è svolto da Luciano Floridi, con il volume The Ethics of Information (2013), e successivamente con la promozione del progetto AI4People, che nel 2018 propone il primo framework etico europeo per una «buona società dell’IA»[3].

Parallelamente, emergono studi come quello di Mittelstadt et al. (2016), che mettono in luce i problemi sistemici degli algoritmi opachi e la necessità di una responsabilizzazione tecnica ed epistemica[4]. Nel contesto italiano, Benanti integra queste riflessioni con una proposta teorica coerente e pubblicamente riconoscibile, rilanciata in opere successive.

A livello normativo, sono degni di nota l’AI Act europeo (2024) e la Raccomandazione UNESCO (2021), che introducono principi e vincoli ispirati all’etica degli algoritmi[5].

- Ambiti e questioni

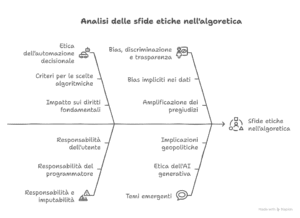

Volendo, ora, semplificare, possiamo asserire che l’algoretica affronti una varietà di problemi, riconducibili a tre macro-ambiti:

- Etica dell’automazione decisionale (quali criteri devono guidare un algoritmo nel compiere scelte che toccano diritti fondamentali, ad esempio in ambito medico, giudiziario o finanziario?);

- Responsabilità e imputabilità (se un algoritmo causa un danno, chi è responsabile — il programmatore, il committente, l’azienda, l’utente?);

- Bias, discriminazioni e trasparenza (come evitare che i sistemi automatici riproducano o amplifichino pregiudizi impliciti nei dati?).

A questi si aggiungono dei temi emergenti, come l’explainability, l’etica dell’AI generativa e le implicazioni geopolitiche e culturali derivanti dalla diffusione globale degli standard algoritmici.

- Prospettive future

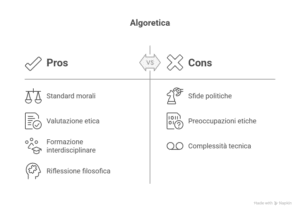

In cima alla china digitale sulla quale al momento ci troviamo, è bene condurre alcune brevi riflessioni sulle prospettive che legittimamente, e realisticamente, possiamo attenderci. Infatti, l’algoretica è destinata ad assumere un ruolo centrale nelle politiche pubbliche e nella progettazione tecnica dell’IA. Le prospettive future includono:

- Sviluppo di standard morali computabili, ossia criteri etici traducibili in specifiche ingegneristiche;

- Istituzionalizzazione della valutazione etica ex ante dei sistemi IA ad alto rischio, attraverso comitati o ethics-by-design;

- Formazione interdisciplinare per ingegneri, giuristi e filosofi, volta a promuovere una governance condivisa;

- Riflessione filosofica sulla natura dell’azione algoritmica, che richiede nuove categorie per pensare l’intenzionalità, l’autonomia e la normatività in ambito post-umano.

In questo senso, dunque, come visto sinora, l’algoretica non è soltanto un campo applicativo, ma una nuova frontiera per la teoria morale e per la concezione contemporanea della responsabilità.

Il punto, però, è un altro, e segnatamente il seguente: ammesso, e non concesso, che l’algoretica riesca nel suo intento, saprà la politica fare altrettanto?

[1] Cfr. P. Benanti, Oracoli. Tra algoretica e algocrazia, Luca Sossella Editore, 2018.

[2] Cfr. L. Floridi, J. Cowls, M. Beltrametti et al., AI4People—An Ethical Framework for a Good AI Society, “Minds and Machines”, vol. 28, 2018, pp. 689–707.

[3] Cfr. L. Floridi, The Ethics of Information, Oxford: Oxford University Press, 2013.

[4] Cfr. B. Mittelstadt, P. Allo, S. Wachter, C. Russell, L. Floridi, The Ethics of Algorithms: Mapping the Debate, “Big Data & Society”, 3(2), 2016.

[5] UNESCO, Recommendation on the Ethics of Artificial Intelligence, 25 novembre 2021. Parlamento Europeo, Artificial Intelligence Act, 13 marzo 2024.

* Articolo prodotto con il supporto dell’AI

Devi fare login per commentare

Accedi