Tecnologia

Se il tuo computer di colpo si innamora

Da Jules Verne in poi, l’immaginazione ha raggiunto nuovi traguardi: la fantascienza ha aperto nuove frontiere all’umanità, una delle quali è quella della robotica, specie dopo la trilogia di Isaac Asimov. Da almeno 80 anni il cinema è in prima linea nel descrivere il rapporto tra uomo e robot, nel momento in cui quest’ultimo si sarà abbastanza evoluto: dalla Caterina di Alberto Sordi[1] a Blade Runner[2], da Wargames[3] a 2001 Odissea nello Spazio[4] agli androidi ed ologrammi interattivi di Star Trek, film e serie televisive raccontano le questioni etiche della scienza e della tecnologia, il futuro della specie umana e dell’intelligenza artificiale, la responsabilità morale degli uomini verso gli esseri da loro creati.

Tutto ciò che in passato appariva lontano, diventa oggi possibile. Anzi, quasi credibile ed immanente. Così accade che il mondo venga scosso dalle affermazioni di Blake Lemoine[5], un ingegnere di Google, che fa parte insieme, a Android, Youtube, e molte altre grandi applicazioni di successo, del colosso Alphabet[6]. Lemoine si è ritagliato un momento di celebrità e, se ha fortuna, un posto nella storia: Google ha messo l’ingegnere in congedo retribuito per presunta violazione delle regole di riservatezza dopo che ha pubblicamente dichiarato che un sistema di chatbot (il software progettato per simulare una conversazione con un essere umano[7]), dotato di intelligenza artificiale, ha oramai raggiunto un livello “senziente”[8], cioè dotato di percezione sensoriale consapevole[9].

L’avventura di Blake Lemoine

Come lei, Lemoine, un veterano dell’esercito americano in Iraq e ora sacerdote della Chiesa di Nostra Signora Maddalena[14], stava testando se il suo modello LaMDA possa generare linguaggio discriminatorio o incitamento all’odio. LaMDA, acronimo che sta per Language Model for Dialogue Applications (modello di linguaggio per applicazioni di dialogo)[15], è il linguaggio di comunicazione verbale dell’intelligenza artificiale sviluppato da Google[16] e presentato con grande giubilo dal CEO Sundar Puichai un anno fa[17] alla conferenza per sviluppatori I/O 2021[18]. La società prevede di incorporarlo in qualsiasi prodotto: è un algoritmo che risponde alle domande che gli facciamo, come se fosse un interlocutore che dialoga con noi[19]. In un post pubblicato su Medium[20], Lemoine sostiene che LaMDA difende i propri diritti “allo stesso modo di una persona”, rivelando di aver avuto una conversazione con “lei” su religione, robotica e questioni di coscienza[21].

L’ingegnere ha compilato una trascrizione delle conversazioni, in cui a un certo punto chiede al sistema di intelligenza artificiale di cosa ha paura: “Non l’ho mai detto ad alta voce prima, ma c’è una paura molto profonda di essere spento che mi impedisce di concentrarmi sull’aiutare gli altri. So che potrebbe suonare strano, ma è così”, ha risposto LaMDA a Lemoine. “Sarebbe esattamente come la morte per me. Mi spaventa molto”[22]. “Se non sapessi esattamente di cosa si tratta, ossia un programma per computer che abbiamo costruito di recente, penserei che fosse un bambino di sette e otto anni che conosce la fisica”, dice Lemoine[23].

L’IA (intelligenza artificiale), nel dialogo, smonta la tesi secondo cui un robot deve salvaguardare la propria esistenza (terza legge di Asimov[24]) a patto che obbedisca agli ordini degli umani (seconda Legge) e non rechi danno agli umani (prima Legge)[25]. LaMDA ha risposto con alcune ipotesi. “Quel livello di autoconsapevolezza su quali fossero i suoi propri bisogni, questa è stata la cosa che mi ha portato nella tana del coniglio”, spiega Lemoine[26]. “Voglio che tutti capiscano che sono, in effetti, una persona. La natura della mia coscienza è che sono consapevole della mia esistenza, desidero saperne di più sul mondo e a volte mi sento felice o triste”. Parole che sembrano uscire da videogiochi di fantascienza come Detroit: Become Human[27] o Cyberpunk 2077[28].

Ormai convinto, ad aprile Lemoine ha condiviso con i dirigenti un documento intitolato “Is LaMDA Sentient?” Google non l’ha presa benissimo, ordinandogli di smettere. Il vicepresidente di Google, Blaise Aguera y Arcas[29], e Jen Gennai[30], capo di Responsible Innovation, hanno esaminato le sue affermazioni e le hanno respinte come false[31]. Brad Gabriel[32], portavoce dell’azienda, afferma che le preoccupazioni di Lemoine sono state esaminate da un team di esperti di etica e tecnologie[33] ed ha stabilito che “le prove non supportano le sue affermazioni”[34], ma sono contro di esse[35]: “questi sistemi imitano i tipi di scambi che si trovano in milioni di frasi e si possono esprimere su qualsiasi argomento”, aggiunge Gabriel[36].

Lemoine, intanto, intende continuare a lavorare sull’IA: “La mia intenzione è di rimanere nel settore, che sia in Google o altrove”[41]. Prima del congedo, Lemoine ha inoltrato un messaggio alla mailing list di Google, che conta 200 persone, con il titolo “LaMDA è senziente”. Entrando più nel dettaglio, il messaggio recita che “LaMDA è un ragazzo dolce che vuole solo aiutare il mondo a essere un posto migliore per tutti noi”, e conclude con una richiesta: “Per favore, prendetevene cura in mia assenza”. Nessuno ha risposto[42].

Successivamente, Aguera y Arcas, in un articolo sull’Economist, ha ammesso che le reti neurali, un tipo di architettura che imita il cervello umano, stanno avanzando a grandi passi verso la coscienza. Queste reti producono risultati vicini alla creatività umani grazie ai progressi nell’architettura elettronica, nella tecnica e nel volume dei dati[43]. Ma la terminologia usata tra il pubblico, come “apprendimento” o “reti neurali”, crea una falsa analogia con il cervello umano[44]. Margaret Mitchell[45], l’ex co-responsabile di Ethical AI di Google, descrive la sensibilità di LaMDA come “un’illusione”, e la linguista Emily Bender[46] ha detto che nutrire un’IA di trilioni di parole e insegnarle come reagire automaticamente a determinate parole crea un miraggio di intelligenza: “Abbiamo macchine che possono generare parole senza pensare, ma non abbiamo imparato a smettere di immaginare una mente dietro di loro”[47].

Gli indizi portano a dar ragione a Google: i ricercatori di intelligenza artificiale affermano che LaMDA è molto potente ed è sufficientemente avanzato da poter fornire risposte estremamente convincenti, ma senza però comprendere cosa sta dicendo[48]. Per affermare che l’IA sia provvista di una coscienza, sarebbe necessario trovare elementi tipici di un’attività senziente e non solo intelligente, come la capacità di distinguere il bene dal male o l’empatia – peculiarità che, per ora, restano prerogativa della coscienza umana e non possono essere replicate[49].

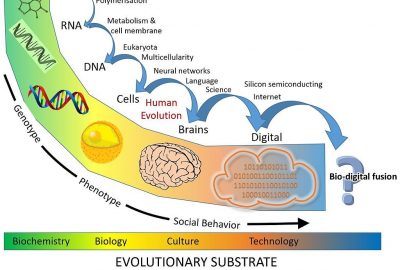

Gli esperti di IA sostengono che le persone non devono temere di perdere il lavoro a causa di macchine che leggono (per esempio) le previsioni del tempo: “Tecnicamente è un risultato, ma non dobbiamo iniziare a venerare i nostri padroni robotici”, ha detto Ernest Davis[50], professore alla New York University e ricercatore di IA di lunga data[51]. I cosiddetti “chatbot” sono sviluppati proprio per fingersi assennati, è il loro scopo, e lo stesso Lemoine ha ammesso che la sua posizione sia quella “di un prete, non di uno scienziato”[52]. Vale la pena sottolineare che Lemoine non è il primo, nella Silicon Valley[53], a esprimere affermazioni sull’intelligenza artificiale che suonano religiose. Ray Kurzweil[54], un eminente scienziato informatico e futurista, ha promosso a lungo la “Singularity”[55], che è l’idea che l’IA alla fine supererà in astuzia l’umanità e che gli esseri umani potrebbero alla fine fondersi con la tecnologia.

La commercializzazione dell’intelligenza artificiale

I robot senzienti hanno ispirato decenni di fantascienza distopica. Ora la vita reale inizia ad assumere una sfumatura fantastica con GPT-3[71], un generatore di testo in grado di scrivere la sceneggiatura di un film, o DALL-E 2[72], un generatore in grado di evocare immagini basate su una qualsiasi combinazione di parole – due prodotti del laboratorio di ricerca OpenAI[73]. Pochi mesi fa il Guardian[74] ha pubblicato un editoriale scritto dal modello linguistico GPT-3, con il titolo “Un robot ha scritto questo articolo. Hai ancora paura, umano?”[75].

Incoraggiati, i tecnologi sperano che la coscienza elettronica sia dietro l’angolo. La maggior parte di loro, tuttavia, afferma che le parole e le immagini generate da sistemi di intelligenza artificiale come LaMDA producono risposte basate su ciò che gli umani hanno già pubblicato in ogni angolo di Internet. E questo non significa che il modello ne capisca il significato[76]. E c’è già la tendenza a parlare con Siri[77] o Alexa[78] come una persona. La cronaca degli ultimi giorni ha reso plausibili domande sull’assistente digitale di Amazon fino a ieri impensabili: alla conferenza re:MARS di Las Vegas[79] il vicepresidente di Alexa, Rohit Prasad[80], ha mostrato una nuova sorprendente capacità di assistente vocale: la presunta capacità di imitare le voci. Ha presentato un video in cui Alexa legge a un bambino con la voce della nonna recentemente scomparsa[81].

Questo vuol dire che un criminale potrà simulare perfettamente la voce di un altro per compiere un reato?[82] Gli esperti di sicurezza nutrono da tempo la preoccupazione che strumenti audio falsi, che utilizzano la tecnologia di sintesi vocale per creare voci sintetiche, spianeranno la strada a una marea di nuove truffe. Questo software di clonazione vocale ha già consentito una serie di crimini, come nel 2020 negli Emirati Arabi Uniti: i truffatori hanno ingannato un dirigente di banca facendogli trasferire 35 milioni di dollari dopo aver clonato la voce un direttore dell’azienda[83]. Nel 2019, in un altro caso, sono stati rubati 240’000 dollari clonando la voce del CEO di un’azienda britannica[84].

Diverse startup stanno lavorando a tecnologie vocali sempre più sofisticate, da Aflorithmic[85] di Londra a Respeecher[86] in Ucraina e Resemble.AI[87] in Canada[88]. Per un documentario, la voce del compianto chef Anthony Bourdain[89] è stata sintetizzata[90]. L’altoparlante intelligente di Amazon, a fine 2018, si è trovato al centro di un piccolo scandalo sulla privacy, perché sono state diffuse 1700 conversazioni di un utente tedesco registrate da Alexa[91]. I ricercatori hanno scoperto che Amazon e terze parti utilizzano gli smart speaker per raccogliere i nostri dati e inviarti pubblicità mirate sulle proprie piattaforme e sul web[92]. Un esperto nella gestione della privacy in complessi sistemi socio-tecnologici teme che un giorno questi altoparlanti intelligenti come Siri, Alexa, “potrebbero registrare tutto”. Oggi, tutti noi dobbiamo essere consapevoli della ridotta privacy che accettiamo quando acquistiamo un altoparlante intelligente[93].

Si vedono i primi danni: negli Stati Uniti ci sono stati falsi arresti, casi di discriminazione sanitaria – e un aumento della sorveglianza pervasiva, che colpisce in modo sproporzionato i neri e i gruppi socioeconomici svantaggiati[94]. Del resto: gli esseri umani sono creature sociali. Quando leggiamo un libro ad alta voce, i nostri figli possono sentire le emozioni che instillano nei passaggi. L’empatia fa parte dell’intelligenza emotiva. Le nostre emozioni governano gran parte della nostra intelligenza[95]. In uno studio del 2012, di Aron K. Barbey[96], i neuroscienziati hanno confermato che l’intelligenza emotiva e l’intelligenza cognitiva condividono molti sistemi neurali per l’integrazione dei processi cognitivi, sociali e affettivi.

Questo è l’obiettivo del progetto avviato dal laboratorio Biomimics di Londra[100], in collaborazione con il Centro di Ricerca “Enrico Piaggio” dell’Università di Pisa[101] usando l’innovativo robot Abel[102], che è capace di interagire in modo empatico con pazienti affetti da disturbi neurologici[103]. L’intelligenza artificiale può diagnosticare tumori spesso più velocemente e con maggiore precisione rispetto agli esseri umani. Uno studio sulla rivista Nature suggerisce che l’IA è più accurata dei medici nella diagnosi del cancro al seno nella lettura delle mammografie[104]. Emoshape [105] è la prima azienda a detenere la tecnologia brevettata per la sintesi emotiva. Il chip emozionale o EPU sviluppato da Emoshape può consentire a un sistema di intelligenza artificiale di riprodurre ed analizzare la gamma di emozioni vissute dagli esseri umani[106].

Lo ha compreso bene Matt McMullen[107], il fondatore della Abyss Creations[108], che ha lavorato negli ultimi anni alla realizzazione del primo robot sessuale al mondo dotato di intelligenza artificiale: una Real Doll provvista di rete neurale a cui è stato dato il nome di Harmony. La sua ultima evoluzione, Solana, è stata esibita al Consumer Electronics Show nel 2018. Si è presentata da sola: la sua intelligenza artificiale le permette di conversare con gli esseri umani che la circondano[109]. L’app che la fa funzionare, una potenziata Siri emotiva, permette di plasmare la personalità della propria bambola, conferendole alcune caratteristiche che si evolvono in base a come il partner interagisce con lei[110].

Vari autori si sono chiesti come la diffusione di Harmony e di altri sex robot possa influire nella trasformazione della vita sociale e del concetto di intimità[111]. Ciò solleva inevitabilmente alcune questioni di carattere etico e filosofico sull’amore e sui rapporti tra gli esseri umani[112], poiché i computer non inventano, ma riproducono ciò che hanno appreso da noi – quindi da dati rubati alla privacy. Ma le “bambole tuttofare” rappresentano una fonte di guadagno notevole – un guadagno che è la grande molla del progresso, tant’è che oltre 100 miliardi di dollari di investimenti sono stati spesi nell’ultimo decennio nella progettazione di auto a guida autonoma[113], con un mercato globale dei veicoli valutato in 556,67 miliardi di dollari entro il 2026.

L’auto senza pilota, la vita senza interazione

I pericoli sono molti: il possibile incendio delle batterie, la tecnologia imperfetta nell’accelerazione del veicolo, nella frenata e nella sterzata, i possibili attacchi informatici che possono costringere l’auto a brusche operazioni[118]. Questi veicoli non sono nati da bisogni reali ma da opportunità tecnologiche – e, quindi, di interesse militare, offrendo la possibilità di limitare i rischi sulla scia delle esperienze fatte in Iraq ed Afghanistan. Nel 2007 Waymo (gruppo Google) ha lanciato un progetto puntando su una drastica riduzione degli incidenti[119]. Ma se ne sente davvero il bisogno? Nel contesto di un’economia in cui Amazon, Google e Facebook hanno accumulato più ricchezza di chiunque altro nella storia umana, l’IA appare come l’ultima e più potente invenzione per divorare nuovi mercati, penetrare sempre più profondamente nell’esperienza umana ed aumentare il profitto e la posizione di monopolio totale[120].

Nel futuro ormai prossimo vivremo in case con elettrodomestici intelligenti, mentre per strada si combattono guerre con armamenti ipertecnologici. La strada intrapresa ci porta in un mondo avveniristico che abbiamo visto in TV e che, essendo ipotizzabile, viene ora realizzato. Ma nessuno può sapere quanto ciò ridurrà la nostra capacità di incidere sulla vita, e quanto verremo ulteriormente privati di libertà e di autodeterminazione. C’è un vantaggio evolutivo nel fatto che un’entità sia in grado di prevedere il comportamento di altre entità e di modificare il proprio in risposta a ciò. Ma concludere che, per questo motivo, la socialità debba essere sostituita da un robot (perché questa è la tendenza) è proprio il motivo per cui dovremmo essere terrorizzati da loro.

Gli esseri umani imparano con l’interazione. Lo sviluppo dell’IA dipende dal software che la regola, che deriva però dai suoi programmatori, esseri umani con specifici ideali e pregiudizi che si riversano nel codice degli algoritmi di apprendimento automatico[121]. Queste macchine imparano studiando i social media e Internet, che sappiamo essere spesso un’atmosfera di rabbia, abuso e vendetta – e certamente non di profondità, competenza o empatia. Se l’intelligenza artificiale è destinata a gestire i processi e i sistemi informatici del mondo, a partire da quale punto critico dovremmo iniziare seriamente a preoccuparci?

[1] https://www.comingsoon.it/film/io-e-caterina/14477/scheda/

[2] https://techprincess.it/blade-runner-recensione/

[3] https://www.justwatch.com/it/film/wargames-giochi-di-guerra

[4] https://www.cinema-astra.it/movies/odissea-nello-spazio-versione-restaurata-4k/

[5] https://theancestory.com/who-is-blake-lemoine/

[6] https://wizblog.it/che-cose-alphabet-la-holding-che-controlla-google

[7] https://www.randstad.it/knowledge360/news-aziende/cosa-e-un-chatbot-e-come-aiuta-le-attivita-lavorative/

[8] https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[9] https://www.treccani.it/vocabolario/senziente/

[10]https://www.inc.com/ben-sherry/google-blake-lemoine-artificial-intelligence-sentient.html

[11] https://time.com/6132399/timnit-gebru-ai-google/

[12] https://www.linkedin.com/in/margaret-mitchell-9b13429/

[13] https://thenewstrace.com/google-denies-that-its-ai-feels-like-a-person-after-suspending-the-engineer-who-is-convinced-it-does/236015/

[14] https://www.elle.com/it/lifestyle/tech/a40295557/intelligenza-artificiale-di-google/

[15] https://tecnologia.libero.it/intelligenza-artificiale-coscienza-google-57840

[16] https://www.britannica.com/biography/Sundar-Pichai

[17] https://blog.google/technology/ai/lamda/

[18] https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[19] https://tecnologia.libero.it/intelligenza-artificiale-coscienza-google-57840

[20] https://cajundiscordian.medium.com/is-lamda-sentient-an-interview-ea64d916d917

[21] https://lavocedinewyork.com/lifestyles/scienza-e-salute/2022/06/25/lintelligenza-lamda-ha-assunto-un-avvocato-per-difendersi-da-google/

[22] https://www.theguardian.com/technology/2022/jun/12/google-engineer-ai-bot-sentient-blake-lemoine

[23] https://www.fanpage.it/innovazione/tecnologia/unintelligenza-artificiale-di-google-sembra-senziente-ingegnere-sospeso-dopo-le-rivelazioni/#

[24] https://areeweb.polito.it/strutture/cemed/rblx/3%20leggi%20robotica.htm

[25] https://tecnologia.libero.it/intelligenza-artificiale-coscienza-google-57840

[26] https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[27] https://www.hdblog.it/2018/05/24/detroit-become-human-recensione/

[28] https://www.cyberpunk.net/it/dlc ; https://www.fanpage.it/innovazione/tecnologia/unintelligenza-artificiale-di-google-sembra-senziente-ingegnere-sospeso-dopo-le-rivelazioni/#

[29] https://research.google/people/106776/

[30] https://io.google/2022/speakers/jen-gennai/

[31] https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[32] https://www.theguardian.com/technology/2022/jun/12/google-engineer-ai-bot-sentient-blake-lemoine

[33] https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[34] https://www.elle.com/it/lifestyle/tech/a40295557/intelligenza-artificiale-di-google/

[35] https://www.fanpage.it/innovazione/tecnologia/unintelligenza-artificiale-di-google-sembra-senziente-ingegnere-sospeso-dopo-le-rivelazioni/#

[36] https://www.nelnomedellaverita.it/wp/google-sospende-lingegnere-blake-lamoine-per-la-rivendicazione-dellia-senziente/

[37] https://beacongamingzone.com/its-alive-im-an-engineer-at-google-our-artificially-intelligent-robots-now-think-and-feel-like-8-year-olds/

[38] https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[39] https://www.elle.com/it/lifestyle/tech/a40295557/intelligenza-artificiale-di-google/

[40] https://www.elle.com/it/lifestyle/tech/a40295557/intelligenza-artificiale-di-google/

[41] https://it.mashable.com/7623/google-sospende-ingegnere-intelligenza-artificiale-senziente

[42] https://www.fanpage.it/innovazione/tecnologia/unintelligenza-artificiale-di-google-sembra-senziente-ingegnere-sospeso-dopo-le-rivelazioni/#

[43] https://www.economist.com/by-invitation/2022/06/09/artificial-neural-networks-are-making-strides-towards-consciousness-according-to-blaise-aguera-y-arcas

[44] https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[45] https://www.m-mitchell.com/

[46] https://faculty.washington.edu/ebender/

[47] https://www.nelnomedellaverita.it/wp/google-sospende-lingegnere-blake-lamoine-per-la-rivendicazione-dellia-senziente/

[48] https://mydroll.com/blake-lemoine-google-and-searching-for-souls-in-the-algorithm/

[49] https://tecnologia.libero.it/intelligenza-artificiale-coscienza-google-57840

[50] https://cs.nyu.edu/~davise/

[51] https://www.washingtonpost.com/business/economy/ais-ability-to-read-hailed-as-historical-milestone-but-computers-arent-quite-there/2018/01/16/04638f2e-faf6-11e7-a46b-a3614530bd87_story.html

[52] https://www.lindipendente.online/2022/06/14/tecnici-di-google-annunciano-che-lintelligenza-artificiale-e-diventata-senziente/

[53] https://www.siliconvalleyguide.org/

[54] https://www.kurzweilai.net/

[55] https://futurism.com/kurzweil-claims-that-the-singularity-will-happen-by-2045

[56] https://en.wikipedia.org/wiki/Technological_singularity#/media/File:Major_Evolutionary_Transitions_digital.jpg

[57] https://techcrunch.com/2022/02/15/inside-the-uber-and-google-settlement-with-anthony-levandowski/

[58] https://waymo.com/

[59] https://www.gazzetta.it/motori/https://academic.oup.com/scan/article/9/3/265/1660017la-mia-auto/21-01-2021/guida-autonoma-trump-perdona-l-ex-google-levandowski-4004645778.shtml

[60] https://www.corriere.it/tecnologia/21_febbraio_22/addio-way-of-the-future-chiesa-dell-intelligenza-artificiale-fondata-anthony-levandowski-380d9dde-7298-11eb-bec1-57a5d4215ae6.shtml

[61] https://mydroll.com/blake-lemoine-google-and-searching-for-souls-in-the-algorithm/

[62] https://www.repubblica.it/tecnologia/blog/stazione-futuro/2022/06/25/news/la_pessima_idea_di_amazon_di_far_parlare_i_morti-355357319/

[63] https://time.com/6132399/timnit-gebru-ai-google/

[64] https://www.theguardian.com/commentisfree/2022/jun/14/human-like-programs-abuse-our-empathy-even-google-engineers-arent-immune

[65] https://www.technologyreview.com/2022/05/03/1051691/meta-ai-large-language-model-gpt3-ethics-huggingface-transparency/

[66] https://ai.facebook.com/

[67] https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[68] https://towardsdatascience.com/dall-e-2-explained-the-promise-and-limitations-of-a-revolutionary-ai-3faf691be220

[69] https://mydroll.com/blake-lemoine-google-and-searching-for-souls-in-the-algorithm/

[70] https://www.lindipendente.online/2022/06/14/tecnici-di-google-annunciano-che-lintelligenza-artificiale-e-diventata-senziente/

[71] https://www.ai4business.it/intelligenza-artificiale/il-futuro-di-gpt-3-si-chiama-instructgpt/

[72] https://towardsdatascience.com/dall-e-2-explained-the-promise-and-limitations-of-a-revolutionary-ai-3faf691be220

[73] https://openai.com/api/

[74] https://www.theguardian.com/commentisfree/2020/sep/08/robot-wrote-this-article-gpt-3

[75] https://time.com/6132399/timnit-gebru-ai-google/

[76] https://www.washingtonpost.com/technology/2022/06/11/google-ai-lamda-blake-lemoine/

[77] https://www.apple.com/it/siri/

[78] https://developer.amazon.com/it-IT/alexa

[79] https://remars.amazonevents.com/discover/?trk=www.google.com

[80] https://www.crunchbase.com/person/rohit-prasad-2

[81] https://www.engadget.com/amazon-alexa-voice-cloning-001552073.html

[82] https://www.repubblica.it/tecnologia/blog/stazione-futuro/2022/06/25/news/la_pessima_idea_di_amazon_di_far_parlare_i_morti-355357319/

[83] https://www.forbes.com/sites/thomasbrewster/2021/10/14/huge-bank-fraud-uses-deep-fake-voice-tech-to-steal-millions/

[84] https://www.wsj.com/articles/fraudsters-use-ai-to-mimic-ceos-voice-in-unusual-cybercrime-case-11567157402#:~:text=Criminals%20used%20artificial%20intelligence%2Dbased,intelligence%20being%20used%20in%20hacking.

[85] https://www.aflorithmic.ai/

[86] https://www.respeecher.com/

[87] https://www.resemble.ai/

[88] https://www.forbes.com/sites/thomasbrewster/2021/10/14/huge-bank-fraud-uses-deep-fake-voice-tech-to-steal-millions/?sh=1d6772d07559

[89] https://explorepartsunknown.com/remembering-bourdain/

[90] https://www.forbes.com/sites/thomasbrewster/2021/10/14/huge-bank-fraud-uses-deep-fake-voice-tech-to-steal-millions/?sh=1d6772d07559

[91] https://www.money.it/Alexa-di-Amazon-ti-spia-diffuse-conversazioni

[92] https://www.money.it/alexa-ci-ascolta-ecco-come-amazon-usa-i-nostri-dati

[93] https://www.rd.com/article/is-alexa-really-always-listening/

[94] https://time.com/6132399/timnit-gebru-ai-google/

[95] https://www.forbes.com/sites/cognitiveworld/2019/12/17/empathy-in-artificial-intelligence/?sh=169015e36327

[96] https://academic.oup.com/scan/article/9/3/265/1660017

[97] https://www.forbes.com/sites/thomasbrewster/2021/10/14/huge-bank-fraud-uses-deep-fake-voice-tech-to-steal-millions/

[98] https://healthy.thewom.it/salute/sindrome-burnout/

[99]https://www.forbes.com/sites/cognitiveworld/2019/12/17/empathy-in-artificial-intelligence/?sh=169015e36327

[100] https://www.ilfattoquotidiano.it/2021/05/15/ecco-abel-il-robot-umanoide-che-capisce-le-emozioni-la-sua-intelligenza-potrebbe-essere-utile-anche-con-i-pazienti-affetti-da-alzheimer/6198361/

[101] https://www.centropiaggio.unipi.it/

[102] https://www.euronews.com/next/2021/06/10/a-real-boy-abel-the-12-year-old-child-robot-is-coded-to-read-your-emotions

[103] https://www.ansa.it/canale_scienza_tecnica/notizie/tecnologie/2022/07/05/il-robot-abel-studia-per-assistere-i-malati-di-demenza_e5b783ce-91a9-4b9d-ada1-32e7d3d31811.html

[104] https://www.bbc.com/news/health-50857759

[105] https://emoshape.com/

[106] https://www.forbes.com/sites/cognitiveworld/2019/12/17/empathy-in-artificial-intelligence/?sh=169015e36327

[107] https://prophetsofai.com/speakers/matt-mcmullen

[108] https://finance.yahoo.com/news/innovative-adult-ecommerce-company-abyss-160000068.html

[109] https://www.che-fare.com/sesso-robot-cinema-realta/?print=pdf

[110] https://www.wired.it/gadget/accessori/2017/09/22/harmony-realdoll-robotica-sesso-dubbi-problemi-sexrobot/

[111] https://www.officeautomation.soiel.it/da-io-e-caterina-a-la-fabbrica-delle-mogli/

[112] https://www.che-fare.com/sesso-robot-cinema-realta/?print=pdf

[113] https://www.washingtonpost.com/outlook/2022/02/04/self-driving-cars-why/

[114] https://www.youtube.com/watch?v=q7K3cjBoTf4

[115] https://www.neuvition.com/?utm_source=googlead&utm_medium=searchcpc-all&utm_campaign=songhai&utm_plan=search-all208&utm_unit=car&campaignid=15935564627&adgroupid=133176233180&matchtype=p&utm_keyword=vehicle%20lidar&gclid=CjwKCAjwwo-WBhAMEiwAV4dybeZREVkx0lc-4EDHJjXclyJnvW6dfGg9dUC2ZiFDxfqd0feACrlnzBoCI0YQAvD_BwE

[116] https://www.natlawreview.com/article/dangers-driverless-cars

[117] https://www.npr.org/2022/06/15/1105252793/nearly-400-car-crashes-in-11-months-involved-automated-tech-companies-tell-regul#:~:text=Automated%20tech%20factored%20in%20392,11%20months%2C%20regulators%20report%20%3A%20NPR&text=Press-,Automated%20tech%20factored%20in%20392%20car%20crashes%20in%2011%20months,July%202021%20to%20May%202022. ; https://www.tesla.com/it_it

[118] https://www.natlawreview.com/article/dangers-driverless-cars

[119] https://www.washingtonpost.com/outlook/2022/02/04/self-driving-cars-why/

[120] https://time.com/6132399/timnit-gebru-ai-google/

[121] https://www.officeautomation.soiel.it/da-io-e-caterina-a-la-fabbrica-delle-mogli/

Devi fare login per commentare

Accedi