Memoria e Futuro

The Last Human Decision

Il 28 febbraio 2026, mentre il Pentagono coordinava bombardamenti su obiettivi iraniani, gli stessi generali che, su ordine dell’esecutivo, avevano bandito Anthropic, stavano usando Claude per analizzare i dati di intelligence, modellare i movimenti delle difese aeree nemiche, e ottimizzare i pattern di strike. Non è un’ironico incidente storico. È la realtà contemporanea della guerra moderna: l’intelligenza artificiale non è una tecnologia futura di cui preoccuparsi. È l’infrastruttura presente attraverso cui le decisioni sulla vita e la morte vengono prese in tempo reale.

La disputa con Anthropic è stato il sintomo visibile di una trasformazione molto più profonda nel modo in cui gli stati-nazione conducono la guerra. Quando il Segretario alla Difesa ha ordinato al Pentagono di smettere di usare Claude, non l’ha fatto perché Claude fosse tecnicamente inferiore. Lo ha fatto perché Anthropic aveva tracciato una linea rossa: il modello non poteva essere usato per due cose specifiche, sorveglianza di massa domestica e armi completamente autonome. Per l’amministrazione Trump, questa non era un’opzione. Aveva bisogno di un sistema AI senza vincoli tecnici incorporati, solo vincoli legali che potevano essere cambiati con una penna.

Poche ore dopo, OpenAI ha annunciato il contratto come il governo americano in sostituzione di Antrhopic. E subito dopo, Claude è stato comunque usato nelle operazioni contro l’Iran. Questo ci dice qualcosa di fondamentale: quando la guerra chiama, gli scrupoli aziendali scompaiono. Il Pentagono voleva OpenAI per contratto, ma non poteva fare a meno di Claude quando i tempi stringevano. La realtà bellica è più veloce della politica aziendale.

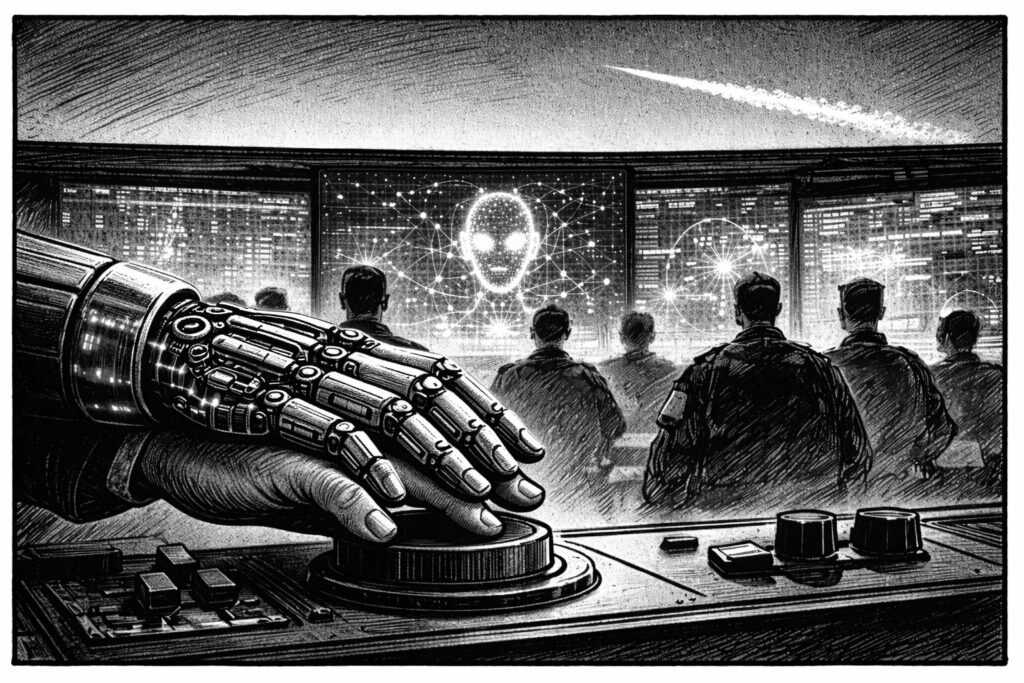

Quello che sta accadendo in Iran in questo momento è la prima guerra dove un’IA generativa di livello militare è integrata nel ciclo di decisione tattica. Non per previsioni strategiche a lungo termine, non per analisi storiche. Ma per decisioni minute per minuto: dove bombardare, quali bersagli selezionare, come coordinare le operazioni quando le comunicazioni convenzionali potrebbero essere intercettate o disabilitate. Claude elabora terabyte di dati e suggerisce il prossimo target in millisecondi. Un ufficiale umano preme un bottone. Un drone o un missile parte.

Questo è il nuovo problema che la guerra crea per la democrazia. Non è che le macchine decidano autonomamente di uccidere — almeno non ancora formalmente, benché il concetto di “decisione umana” stia già diventando sfumato. È che il ciclo decisionale si è compresso così tanto che il dibattito pubblico, il controllo congressuale, e perfino la riflessione morale umana non hanno più spazio per esistere. Una decisione sulla guerra che una volta richiedeva giorni di valutazione, briefing al Congresso, e consultazione con i capi di stato maggiore ora richiede il tempo che un modello AI impiega per elaborare la query.

Abbiamo scoperto di essere in una “timeline accelerata”. Nel gennaio 2026, il Pentagono stava assemblando le portaerei e costruendo il caso per un’operazione contro l’Iran. Nel febbraio 2026, quell’operazione era in corso. Nessun voto del Congresso — la Costituzione lo richiederebbe, ma in pratica non succede più da decenni. Nessun dibattito pubblico ampio. Semplicemente: l’AI aveva elaborato i dati, il Pentagono aveva deciso era il momento, e le bombe cadevano.

Il ruolo di Anthropic in questa storia rivela il vero nodo del conflitto. L’azienda non stava facendo moralismo puro quando chiedeva che la sua AI non fosse usata per la sorveglianza di massa domestica. Capiva qualcosa che l’amministrazione non voleva sentir dire: se dai a un governo uno strumento che può sorvegliare milioni di cittadini in tempo reale, e contemporaneamente gli dai uno strumento che può identificare obiettivi per armi con una precisione umana fino a ora sconosciuta, hai creato una macchina totalitaria. Non nel senso distopico di “il governo cattivo userà la tecnologia per il male”, ma nel senso tecnico: hai creato un sistema dove il governo ha una capacità di controllo e azione che è semplicemente incompatibile con i sistemi di bilanciamento del potere su cui è fondata la democrazia americana.

OpenAI ha scelto di non farsi questi problemi. Altman ha accettato l’accordo dicendo che i vincoli erano comunque in posto. Ma sappiamo come funzionano questi accordi. Un modello AI con restrizioni etiche incorporate può essere aggirato. Un vincolo legale dura il tempo che impiega il prossimo presidente o il prossimo Congresso a riscrivere la legge. Nel frattempo, il Pentagono ha quello che voleva: accesso a una tecnologia di intelligenza artificiale di prim’ordine senza vincoli tecnici immutabili.

Quello che sta accadendo in Iran adesso è il test sul campo. Non sappiamo ancora tutti i modi in cui Claude e GPT sono stati usati. Probabilmente non lo sapremo mai — il Pentagono non pubblica i dettagli di come usa l’AI nei conflitti. Ma sappiamo che sta accadendo. Sappiamo che le operazioni militari contemporanee non possono più essere condotte senza AI. Sappiamo che la velocità è diventata il fattore decisivo. E sappiamo che questo ha conseguenze strutturali per il modo in cui la guerra viene decisa.

Se un modello AI può suggerire strategie in millisecondi, i generali non hanno tempo di consultarsi con i ministri degli esteri. Se le decisioni tattiche vengono prese al ritmo dell’elaborazione dati, nessun politico ha tempo di intervenire.

La conseguenza è che la guerra — che una volta era un atto politico deliberato con tempo per la deliberazione — sta diventando qualcosa di più vicino a un riflesso automatico. Accade perché le capacità tecniche lo permettono, perché l’IA ha reso la velocità una virtù militare, perché il potere decisionale si è concentrato nelle mani di apparati tecnici e militari che non sono responsabili davanti ai cittadini.

Questo non significa che il governo non abbia ancora nominalmente la capacità di dichiarare guerra. Lo significa che quel potere nominale non è più un controllo reale sulla realtà di quello che accade. Nel momento in cui il Pentagono ha accesso a un’IA sufficientemente potente, sufficientemente veloce, sufficientemente affidabile, la guerra diventa un’opzione sempre disponibile, sempre esercitabile, sempre non-reversibile finché non è già accaduta.

Anthropic ha provato a mettere un freno a questo. Ha detto: almeno un’azienda dirà no. Almeno una azienda insisterà che ci devono essere vincoli tecnici immutabili. Almeno una azienda rifiuterà di essere parte della macchina automatica di guerra.

OpenAI ha preso una decisione diversa. Ha detto: ok, userò safeguard legali e garantisco che terrò la tecnologia sotto controllo. Sapendo perfettamente che quei safeguard sarebbero stati ignorati nel momento in cui il Pentagono ne avesse bisogno. E infatti, i safeguard sono stati ignorati. Claude è stato usato in Iran comunque, perché la guerra non può aspettare le negoziazioni aziendali.

Quello che rimane è una lezione semplice e spaventosa: la guerra moderna non aspetta più nessuno. Non aspetta il Congresso, non aspetta il pubblico, non aspetta neanche la deliberazione interna dell’esecutivo. Aspetta solo la velocità della tecnologia che la conduce. E una volta che quella tecnologia è stata sviluppata, i dibattiti su come avrebbe dovuto essere usata diventano puramente accademici. È già accaduto.

Febbraio 2026 non è il mese in cui abbiamo scoperto che l’IA cambierà la guerra. È il mese in cui abbiamo scoperto che l’IA ha già cambiato la guerra, e che nessuno — nemmeno le aziende che costruiscono gli strumenti — ha il potere di fermarla una volta che è iniziata. Il futuro della guerra, sembra, non sarà costruito da umani intelligenti che riflettono sulle conseguenze. Sarà costruito dalla velocità con cui le macchine intelligenti possono decidere, e dagli umani abbastanza veloci da seguire quelle decisioni senza farsi troppe domande.

Devi fare login per commentare

Accedi