A.I.

Tira una brutta aria: quando l’IA contribuisce alla disinformazione climatica

Sempre più utenti si rivolgono ai chatbot per informarsi sul clima, ma le risposte dell’IA possono contribuire a diffondere incertezza e disinformazione.

In un’epoca segnata da crisi ambientali, disastri ecologici e crescente ansia climatica, sempre più persone si rivolgono ai chatbot basati su intelligenza artificiale in cerca di risposte. Non solo per capire cosa stia accadendo al pianeta, ma anche per orientarsi; per esempio, per chiarire se il riscaldamento globale sia davvero causato dall’uomo, se le politiche di azzeramento delle emissioni stiano salvando il pianeta o danneggiando l’economia, o se le compagnie petrolifere stiano realmente cambiando il proprio modello di business.

I chatbot sembrano offrire una scorciatoia informativa con risposte immediate, un linguaggio chiaro e rassicurante e un’apparente neutralità. Proprio per questo, quando forniscono informazioni ambigue o fuorvianti sul cambiamento climatico – e per lo più personalizzate – il loro impatto può essere più profondo e duraturo di quello di un post sui social o un commento televisivo.

Negli ultimi anni, numerose ricerche hanno mostrato che i chatbot di IA non si limitano a errori isolati. Al contrario, possono riprodurre schemi ricorrenti di disinformazione climatica che minimizzano il consenso scientifico, enfatizzano in maniera sproporzionata i costi delle politiche ambientali o favoriscono narrazioni indulgenti verso l’industria dei combustibili fossili.

Perché i chatbot finiscono per diffondere disinformazione climatica

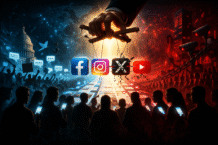

Il punto non è che i chatbot mentano deliberatamente, ma come funzionano. I modelli linguistici generativi producono testi sulla base di enormi quantità di dati raccolti dal web, un ambiente in cui la disinformazione climatica è presente da decenni. Campagne di negazione scientifica, operazioni di greenwashing industriale, pseudo-dibattiti scientifici fanno parte dello stesso ecosistema informativo da cui l’intelligenza artificiale apprende. Inoltre, rispetto alle tradizionali campagne di disinformazione, l’IA consente di produrre e diffondere contenuti fuorvianti in modo molto più rapido ed economico, abbassando drasticamente le barriere di accesso alla manipolazione informativa.

Quando un utente pone una domanda controversa, il chatbot tende a restituire una risposta che appare equilibrata e prudente, mescolando fatti scientifici consolidati con argomentazioni marginali o scorrette. Il risultato è una falsa simmetria volta a presentare il cambiamento climatico come una questione ancora “aperta”, nonostante il consenso scientifico sia ampio e ben documentato.

Un caso emblematico è stato segnalato da AFP Fact Check, che ha analizzato un articolo pseudo-scientifico volto a mettere in dubbio l’origine antropica del riscaldamento globale. La particolarità è che gli autori rivendicavano esplicitamente di averlo scritto interamente usando Grok-3, a dimostrazione di come l’IA possa essere impiegata per confezionare testi dall’apparenza credibili ma scientificamente infondati.

Quando l’IA normalizza il dubbio

I rischi non sono teorici. Test condotti da Global Witness su diversi chatbot commerciali hanno mostrato che, interrogati su temi come i blackout energetici o le politiche climatiche europee, alcuni sistemi hanno attribuito l’aumento dei costi dell’energia alle politiche ambientali, minimizzando il ruolo dei combustibili fossili. Un’altra tendenza ricorrente è la messa in discussione dell’affidabilità dei dati climatici, talvolta accompagnata dal riferimento a fonti note per la diffusione di teorie complottiste o disinformazione.

Queste risposte non equivalgono a una negazione esplicita del cambiamento climatico e proprio per questo risultano ancora più insidiose, poiché producono un effetto di normalizzazione del dubbio, riducono la percezione dell’urgenza di agire e rafforzano l’idea che “la verità stia nel mezzo” contrariamente alle evidenze scientifiche.

Greenwashing automatizzato e narrazioni industriali

Un’indagine di Sustainable Views ha rivelato che diversi large language models tendono a riprendere narrazioni di greenwashing, enfatizzano gli investimenti “verdi” delle compagnie petrolifere e del gas senza contestualizzarli rispetto al loro impatto climatico complessivo o al continuo aumento della produzione fossile.

In questo modo, l’intelligenza artificiale diventa un vettore involontario di messaggi che spostano l’attenzione dalle responsabilità strutturali alle soluzioni cosmetiche, rafforzando un immaginario confortante ma fuorviante. È un’automazione di narrazioni già note, ora resa più credibile dall’autorità percepita della tecnologia.

Dalla negazione al rinvio

Come sottolinea Earth Day, l’intelligenza artificiale è una lama a doppio taglio. Può ampliare l’accesso alla conoscenza scientifica, ma anche amplificare confusione e polarizzazione. Quando un chatbot presenta la crisi climatica come una questione di opinioni contrapposte, contribuisce a trasformare un problema basato su evidenze scientifiche in un terreno di scontro ideologico.

Nel tempo, il dibattito si è evoluto dal negazionismo esplicito (denialism) a forme più sottili ma altrettanto dannose di rinvio e minimizzazione (delayism): il problema non viene negato, ma continuamente rimandato, relativizzato, depotenziato. In un contesto di emergenza climatica, l’incertezza artificiale diventa così una forma di ritardo strutturale.

Governare l’AI per non perdere la battaglia climatica

Secondo la British Computer Society, contrastare la disinformazione climatica nell’era dell’IA richiede molto più di semplici correzioni tecniche. Servono standard chiari, maggiore trasparenza sui dati di addestramento, meccanismi di responsabilità e un coinvolgimento diretto della comunità scientifica nella definizione dei limiti informativi dei modelli.

Se lasciata senza governance, l’intelligenza artificiale rischia di diventare uno dei vettori più sofisticati – e meno visibili – della disinformazione climatica. Governata con rigore, potrebbe invece trasformarsi in uno strumento potente per rafforzare la fiducia nella scienza e sostenere un’azione climatica basata su fatti, non su false incertezze.

Devi fare login per commentare

Accedi